Roberto Renzetti

GLI SVILUPPI DELL’ASTRONOMIA DOPO HERSCHEL

La grande quantità di scoperte astronomiche del Settecento richiedeva sistemazioni sempre più raffinate utilizzando i potenti strumenti che l’analisi metteva a disposizione, congiuntamente a tecniche e strumenti di osservazione sempre più evoluti. Si studiavano nei dettagli le orbite planetarie e si scrutava il cielo con potenti telescopi. Indagando nella zona tra Marte e Giove si iniziarono a scoprire alcuni asteroidi presenti in quella fascia. Fu Giuseppe Piazzi, che lavorò nei primi osservatori italiani da lui stesso fondati a Palermo e Napoli, a scoprire il primo asteroide (o pianeta nano come Plutone), Cerere, nel gennaio del 1801. Riuscì a fare solo poche osservazioni, non sufficienti per determinarne l’orbita. Notizia dell’osservazione apparve sul Monatliche Correspondenz. Fu Gauss a calcolarne la traiettoria mentre il tedesco Heinrich Olbers (1758-1840) e l’unghereseFranz Xaver von Zach (1754-1832) ne confermarono l’osservazione nel dicembre del 1801. Olbers, sul quale tornerò nel paragrafo seguente, scoprì subito dopo gli asteroidi Pallade e 4 Vesta e per primo avanzò l’ipotesi che la fascia di asteroidi fosse il residuo della frammentazione di un qualche pianeta precedentemente situato tra Marte e Giove. Alcuni di tali asteroidi presentavano parametri, come eccentricità ed inclinazione dell’orbita rispetto all’eclittica, molto accentuati e rendevano quindi necessari ulteriori calcoli ed elaborazioni per ricondurre tali parametri alla gravitazione universale al fine di calcolarne le effemeridi in modo da ritrovare gli asteroidi in successive opposizioni. Su questo complesso problema si cimentò Karl Friedrich Gauss (1777-1855) che si dedicò dal 1800 al 1829 all’astronomia. Egli sviluppò un metodo per calcolare un orbita date tre osservazioni ed applicò quindi la correzione con il metodo matematico, da lui stesso inventato (1794), dei minimi quadrati (che, tra l’altro, serve appunto per la valutazione degli errori in un calcolo come quello che Gauss faceva). Pubblicò i risultati nel 1809 quando ebbe fatto tutte le verifiche. Nel libro vi è una trattazione completa dei fondamenti per il calcolo delle orbite di pianeti, asteroidi e comete, con annessa la teoria delle perturbazioni prodotte dai pianeti maggiori. Il lavoro fu integrato successivamente tra il 1821 ed il 1828 da studi di statistica con la teoria della distribuzione normale degli errori e l’introduzione della famosa curva a campana (gaussiana)(1).

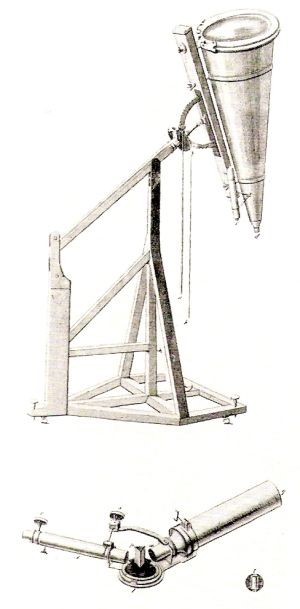

Siamo ormai nell’Ottocento e, a lato dell’astronomia, si sviluppavano, insieme alla tecnologia, altre branche della fisica, come ottica, natura della luce, effetto Doppler, spettroscopia, elettromagnetismo, termodinamica, …, che dettero un grande apporto all’osservazione attraverso strumenti sempre più perfezionati e sofisticati ed attraverso una conoscenza più profonda dei fenomeni fisici in gioco. Molte misure venivano fatte per calcolare la parallasse di stelle e per questo era eccellente l’eliometro, uno strumento nato da un progetto di Bessel e dalla realizzazione, mediante perfezionamenti ad un telescopio, del fisico e costruttore di strumenti tedesco Joseph Von Fraunhofer (1787-1826). Questo scienziato aveva migliorato di molto le lenti acromatiche (che eliminano l’aberrazione cromatica), aveva già realizzato nel 1814 lo spettroscopio, nel 1821, il reticolo di diffrazione, strumenti con cui aveva osservato per primo gli spettri di alcuni astri (del Sole, di Sirio, di altre stelle e pianeti) notando la diversità tra essi, come vedremo più oltre. L’eliometro, così chiamato perché in origine doveva servire a misure del Sole, è un telescopio rifrattore con un’importantissima modifica nell’obiettivo che in tale strumento risulta costituito da una lente divisa a metà lungo il diametro. L’invenzione del metodo fu di Pierre Bouguer (1698-1758) che lo illustrò nel 1748. Fraunhofer sostituì i due primitivi obiettivi, identici e montati in parallelo sullo stesso tubo, con un obiettivo unico, tagliato a metà lungo l’asse ottico.

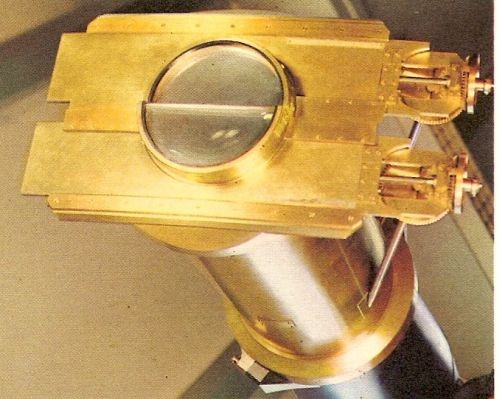

L’eliometro istallato ad Oxford nel 1848

Primo piano dell’obiettivo (parte in alto a sinistra della figura precedente) in cui si vede la lente divisa in due.

Movimento possibile per le due metà della lente obiettivo.

Le due metà della lente si possono muovere come nell’ultima figura. Con tale movimento appare una doppia immagine sul piano focale e le due immagini risultano separate proporzionalmente allo spostamento eseguito delle due metà di lente. Se si vuole misurare la distanza angolare tra una determinata stella ed un punto fisso nella stessa regione (ad esempio un’altra stella). Osservando con le due semilenti separate osserveremo la stella come due punti luminosi separati tra loro. Si regola allora lo spostamento delle due metà della lente in modo che una delle due immagini della stella vada a coincidere con il punto fisso di riferimento (l’altra stella).A questo punto è facile risalire alla distanza angolare tra stella e punto fisso, attraverso la distanza delle due immagini fornite dalle due metà della lente e misurata dalla vite micrometrica che fa spostare le semilenti, divisa per la distanza focale del telescopio utilizzato.

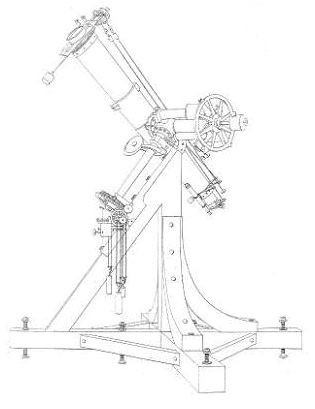

L’eliometro utilizzato da Bessel

Lo strumento era quindi molto utile per misurare parallassi, certamente migliore del micrometro filare fino ad allora utilizzato e al quale ho accennato in precedenti articoli(2).

Col l’eliometro di Fraunhofer, il matematico ed astronomo tedesco Friedrich Wilhelm Bessel (1784-1846) riuscì a misurare nel 1837-1838 a Königsberg la prima parallasse annua della stella 61 Cygni (sistema binario), considerata tra le più vicine perché appariva con un forte moto proprio. Per la misura con l’eliometro egli collegò questa stella ad altre due più vicine che sembravano molto più distanti. Ci vollero moltissime osservazioni per trovare la parallasse cercata che risultò di 0,314″ secondi d’arco (oggi il valore accettato è quello trovato dal satellite Hypparcos, 0,28547″) e, mediante tale valore Bessel stabilì che la distanza di questa stella della Terra era di circa 10 anni luce (l’unità di misura internazionale per distanze astronomiche è il parsec, abbreviazione di parallasse di secondo d’arco, che corrisponde a 3,26 anni luce). La parallasse era estremamente piccola ed è questo il motivo per il quale fino ad allora, con la strumentazione disponibile, non era stata osservata. E’ un passo fondamentale nella storia della scienza che permise di aprire ulteriormente l’universo. Bessel studiò anche con particolare cura due stelle, Sirio e Procione scoprendo, anche con l’introduzione di un nuovo strumento, il cerchio meridiano di Repsold(3), che le due stelle sono multiple avendo le loro compagne invisibili ai telescopi allora in uso. Lavorando infine su dati di Bradley, Bessel determinò con precisione la posizione di 3222 stelle e, insieme al suo assistente W. A. Argenlander (1799-1875), realizzò un catalogo di 324000 stelle nel nostro emisfero (un qualcosa di simile, per l’emisfero meridionale, fu realizzato da E. Schönfeld e successivamente da D. Gill).

Quasi contemporaneamente (1837) l’astronomo tedesco (emigrato in Russia) F. G. Struve (1793-1864), servendosi di un telescopio dotato di micrometro filare, determinava la parallasse di Vega (α Lyrae) ma la precisione di tale misura era poca e fu ripetuta con maggiore precisione da Bessel. A partire da questo momento le misure di parallasse si moltiplicarono. A Struve è dovuto un catalogo di stelle doppie (1820) di molto migliorato negli anni seguenti (Catalogus novus stellarum duplicium del 1827e Stellarum duplicium et multiplicium mensurae micrometricae del 1837)quando dispose per le sue osservazioni di un telescopio rifrattore acromatico di Fraunhofer realizzato nel 1824 per l’osservatorio di Dorpat (Estonia) e di un cerchio meridiano dovuto a Reichenbach ed Ertel.

Telescopio rifrattore acromatico di Fraunhofer

In complesso Struve esaminò 120000 corpi celesti (Stellarum fixarum imprimis duplicium et multiplicium positiones mediae – 1852) e nel suo Études d’astronomie stellaire. Sur la voie lactee et sur la distance des etoiles fixes del 1847 stabilì la presenza di materia assorbente la luce nello spazio interstellare. Tra i suoi vari altri lavori, promosse la necessità di mettere ordine tra le magnitudini delle stelle. La cosa fu realizzata nel 1856 dall’astronomo britannico N. R. Pogson (1829-1891) dell’Osservatorio di Oxford. Egli, basandosi sul fatto che una stella di prima grandezza è circa 100 volte più splendente di una di sesta, stabilì un preciso e costante rapporto tra lo splendore di una stella di una data grandezza e quello di una stella della grandezza immediatamente successiva: la luce di una stella di seconda grandezza è 2,512 volte più debole della luce di una stella di prima grandezza; quella di una stella di terza è 2,512 volte più debole di una stella di seconda e così via. In tal modo, arrivati alla sesta grandezza ritroviamo che la luce emessa da una stella di sesta grandezza è 100 volte più debole di una di prima.

A metà Ottocento eravamo ad un punto estremamente avanzato nelle ricerche. L’universo iniziava ad apparire sempre più mobile, in evoluzione e si presentava una sorta di analogia con il mondo biologico anche per la morte termica adombrata dal secondo principio della termodinamica. In quegli anni si fece strada una tecnica, la spettroscopia, che presto avrebbe trasformato l’astronomia in astrofisica aprendo orizzonti insperati. Ma prima di passare a questo, torniamo un attimo ad Olbers.

IL PARADOSSO DI OLBERS

H. Olbers è autore del primo lavoro scientifico di carattere cosmologico (1823)(4), lavoro che purtroppo rimase lì senza seguito immediato, almeno fino alla fine dell’Ottocento. Dico purtroppo perché, se opportunamente compreso, avrebbe aiutato a capire l’espansione dell’universo che invece fu scoperta per altra via, permettendo la soluzione del paradosso stesso. Si tratta del famoso paradosso di Olbers (il nome paradosso gli fu assegnato da H. Bondi nella sua opera Cosmologia del 1960) che vale la pena discutere.

Nella storia dell’astronomia vi sono stati vari scienziati e pensatori che hanno posto il problema delle stelle che dalla Terra non sono visibili. Iniziò Digges a sostenere che i nostri occhi non sono in grado di vedere le infinite stelle perché troppo distanti, seguì Bruno con gli infiniti mondi, quindi Galileo ad affermare nel Nuncius Sidereus che molti sostengono vi siano molte stelle nascoste nel cielo. La questione fu poi posta in modo più intrigante da Kepler che iniziò a trarre una qualche conseguenza da queste stelle invisibili perché distanti. Egli si muoveva a difesa della sua concezione finita dell’universo da contrapporre al dilagare dei sostenitori di mondi e quindi di stelle infinite. Il suo ragionamento partiva dalla luce proveniente dalle stelle e si sviluppava, nella Dissertatio cum Nuncio Sidereo (1610):

tu [Galileo] non esiti a giudicare che si vedono oltre 10.000 stelle. Quanto più numerose infatti e più fitte esse sono, tanto più valida è la mia argomentazione contro l’infinità del mondo esposta nel mio libro sulla “stella nova”(5). […] Si aggiunga come postilla anche la seguente argomentazione. A me, che sono di vista debole, qua1cuna delle stelle maggiori. come il Cane [Sirio della costellazione del Cane Maggiore] sembrerebbe che per grandezza cedesse di poco al diametro della Luna se ne considerassi anche i fulgidi irraggiamenti: ma quelli che sono di vista del tutto corretta e quelli che usano gli strumenti astronomici. i quali non si lasciano ingannare da queste sbavature come l’occhio nudo, costoro riferiscono le loro misure dei diametri delle stelle parlando di minuti e frazioni di minuti. Che se anche soltanto di mille stelle fisse non ve ne fosse alcuna più grande di un minuto (e in realtà per la maggior parte quelle finora misurate risultano più grandi), esse, riunite tutte insieme in una sola superficie rotonda, eguagliebbero (e anzi supererebbero) il diametro del Sole. Di quanto di più dunque, dieci mila dischetti di stelle riunite in un solo disco supereranno in grandezza visibile l’apparenza di quello del Sole? Se questo è vero, e se quei soli sono del medesimo genere del nostro Sole, perché mai anche tutti quei soli messi insieme non superano in splendore questo nostro Sole? Perché mai negli spazi del tutto aperti del cosmo versano un lume così oscuro, che il Sole, irraggiando in una camera chiusa attraverso il forellino fatto con la piccolissima punta di un sottilissimo ago, subito già supera di una quantità quasi infinita il chiarore delle stelle, quale risulterebbe se fossero tolte tutte le pareti ? [citato da Parini]

Quale che fosse la concezione di Kepler sul numero di stelle e se la natura della luce del Sole fosse differente da quella delle stelle, il problema dell’oscurità del cielo durante la notte era posto. Tale problema, se era ragionevole al tempo di Kepler, diventa una questione da risolvere e da capire quando, nell’Ottocento, si stabilisce che le stelle sono in quantità gigantesca. Comunque, ciò che Kepler aveva sostenuto resta senza seguito, almeno fino al 1720, quando sarà ripreso in un lavoro di Halley(6), nato a seguito di una conversazione con Newton e W. Stukeley (1687-1765). Halley sosteneva la tesi dell’infinità delle stelle ed a sostegno di essa portava tre argomenti. Innanzitutto si realizzavano telescopi sempre più potenti ed ogni volta si individuava un numero sempre maggiore di stelle precedentemente non viste perché troppo deboli. Vi era poi l’illogicità di un universo finito che sarebbe stato un nulla circondato da un vuoto infinito. Infine Halley affermava che se l’universo fosse stato finito sarebbe dovuto collassare a seguito della gravità. E poiché Halley è un gentiluomo discute anche degli argomenti che sosterrebbero la finitezza dell’universo e, tra questi vi è quello che apre la strada al paradosso di Olbers. Scriveva Halley [citazioni da Parini]:

Un’altra Argomentazione ho sentito mettere in evidenza, che se il numero delle Stelle Fisse fosse più che finito, l’intera superficie della loro Sfera apparente sarebbe luminosa …

e la causa di tale supposta luminosità sarebbe la seguente:

quei Corpi splendenti sarebbero maggiori in numero di quanti Secondi di Grado ci sarebbero nell’area dell’intera Superficie Sferica, che io penso non possa essere negato.

Argomentando allo stesso modo di Digges, concludeva che non si ha tale luminosità proprio perché:

le Stelle più remote, c quelle ancora un po’ più lontane, svaniscono anche nei migliori Telescopi, a causa della loro estrema piccolezza; così che, se fosse vero che alcune di tali stelle esistono in un tal luogo. tuttavia i loro impulsi, aiutati da ogni mezzo finora conosciuto, non sono sufficienti per smuovere i nostri sensi; come nella stessa maniera una piccola Stella fissa Telescopica non è affatto percepibile ad Occhio nudo.

I discorsi di Halley sono più complessi di come qui riassunti ma, come osserva Parini, sono confusi ed errati. Tali errori saranno rilevati dall’astronomo svizzero Jean-Philippe Loys de Chéseaux nel 1744(7). Il breve scritto di Chéseaux descriveva in poche e chiare parole il problema:

E’ una proposizione dimostrata in ottica che, se tutte le stelle fisse fossero uguali a dei soli simili al nostro e se le avessimo alla stessa distanza, avrebbero lo stesso diametro ed una luminosità come quella del Sole, e che ci invierebbero la stessa quantità di luce; è dimostrato che la quantità di luce che ognuna di esse invierebbe a qualunque distanza si voglia dalla terra sarebbe quella del Sole, in ragione diretta al quadrato del suo diametro, cioè al quadrato del diametro del Sole, o in ragione inversa di un quarto della distanza al quadrato di quella del Sole. Immaginiamo ora tutto lo spazio stellato diviso in bucce sferiche concentriche e di uno spessore circa costante, uguale a quello del vortice o sistema planetario di ciascuna stella, e supponendo il numero di stelle contenute in ciascuna buccia circa proporzionale alla superficie della buccia medesima o al quadrato della distanza dal Sole, considerato come centro di tutto lo spazio stellato; e supponendo infine i diametri veri di ciascuna stella circa uguali a quelli del Sole, come già ho supposto all’inizio, si troverà la quantità di luce che ci è inviata dalle stelle di ciascuna buccia proporzionale alla somma dei quadrati dei loro diametri apparenti, proporzionale cioè al numero delle stelle di ogni buccia, moltiplicato per il quadrato del diametro apparente di ciascuna o proporzionale al quadrato della distanza di ciascuna buccia diviso per il medesimo quadrato; e in conseguenza tale quantità di luce è sempre la stessa per ogni buccia; e ciascuna avrà, con la quantità di luce che riceviamo dal Sole, il rapporto costante del quadrato della distanza del Sole dalla Terra con il quadrato della distanza della prima buccia diviso per il numero di stelle contenute nella buccia, circa cioè il rapporto di 1 : 4 000 000 000. Da ciò segue che se lo spazio stellato è infinito o solo più grande della prima buccia […] ogni punto del cielo ci sembrerebbe così luminoso che un punto del Sole della stessa grandezza apparente e di conseguenza la luce che noi riceveremmo dall’emisfero celeste che è sul nostro orizzonte sarebbe 91850 volte più intensa di quella che noi riceviamo dal Sole. La differenza enorme che si deduce da questa conclusione e l’esperienza fa vedere o che la sfera delle stelle fisse, non solo non è infinita ma in realtà incomparabilmente più piccola dell’estensione finita che io gli ho assegnato o che l’intensità della luce diminuisce in proporzione più grande dell’inverso del quadrato della distanza. Quest’ultima ipotesi è abbastanza verosimile, essa richiede soltanto che lo spazio stellato sia riempito di qualche fluido capace di intercettare la luce molto lievemente.

Non serve leggere oltre perché tutta la questione è racchiusa in queste pagine. Partendo da almeno due ipotesi ragionevoli rispetto alle concezioni cosmologiche che all’epoca si avevano:

- stelle simili al Sole

- ogni buccia di cielo stellato contribuisce a dare la stessa quantità di luce poiché se da una parte diminuisce il diametro apparente delle stelle, dall’altra aumenta il numero delle stelle in ogni buccia in modo che le due variazioni si compensano.

La conclusione è che la quantità di luce che dovrebbe arrivare sulla Terra sarebbe enorme e, per avere un cielo splendente anche di notte (e per andare tutti arrosto) basterebbe solo la prima buccia di cielo stellato. Se ciò non avviene è perché vi deve essere una qualche materia interstellare che riduce la luminosità delle stelle in modo da riportarla ai livelli che sperimentiamo.

Mi sono dilungato su Chéseaux perché, 80 anni dopo, Olbers svilupperà sulla medesima linea i suoi ragionamenti per costruire quello che, a partire dalla sua memoria, diventerà un paradosso ed anche perché, non si sa se coscientemente o meno, Olbers conosceva il lavoro dell’astronomo svizzero(8) ma non lo citò. In ogni caso dopo questo lavoro non si ebbero più lavori sull’argomento fino a quello di Olbers del 1823/1826.

Olbers, come Chéseaux, suddivideva lo spazio in bucce sferiche concentriche con lo stesso spessore e raggi diversi; quindi faceva la somma della luce inviata da ogni singola buccia; considerava che le stelle di prima grandezza distassero mediamente 5,5 anni luce. Le ipotesi da cui partiva erano praticamente le stesse di Chéseaux che possono essere meglio precisate introducendo anche l’ipotesi non scritta che lo spazio è euclideo, ipotesi all’epoca ancora priva di significato (ed in ogni caso, come si è mostrato, ininfluente):

- la densità media delle stelle e la loro luminosità media non variano attraverso lo spazio ed il tempo

- non vi sono movimenti importanti di gruppi di stelle

- lo spazio è euclideo

- valgono le leggi fisiche note.

Leggiamo cosa scriveva Olbers:

Assumiamo che le stelle fisse siano uniformemente distribuite attraverso tutto lo spazio. Immaginiamo una sfera, con il Sole al centro avente un raggio uguale alla distanza media delle stelle di prima magnitudine. Sia il valore di questo raggio di un’unità. Inoltre, con N1 indichiamo il numero di stelle di prima magnitudine c con δ il raggio di una stella. Troviamo che le stelle più vicine coprono ¼N1δ2 della volta ce1este. Le stelle fisse a distanza 2, di numero 4N1, hanno un diametro apparente ½δ e anch’esse coprono ¼N1δ2 della volta celeste. Quindi, stelle a distanze l, 2, 3, 4, 5, … , m coprono uguali aree della volta celeste e la loro somma

¼N1δ2 + ¼N1δ2 + ¼N1δ2 … = ¼ mN1δ2

diventa infinitamente grande quando m va all’infinito, per quanto piccola sia la quantità ¼δ2. Non solo l’intera volta celeste sarà coperta di stelle, ma le stelle staranno anche una dietro l’altra in file senza fine coprendosi fra loro alla nostra vista. Chiaramente, se le stelle sono uniformemente distribuite nello spazio o raggruppate in sistemi più largamente separati, si giunge alla medesima conclusione. […] Del resto, con tali inimmaginabili luminosità e calore, corrispondenti a 90.000 volte quelli da noi attualmente sperimentati, l’Onnipotente avrebbe potuto benissimo progettare degli organismi capaci di adattarsi a condizioni così estreme. […] Senza dubbio l’universo non è assolutamente trasparente. Solo il più piccolo grado di non trasparenza è sufficiente a refutare la conc1usione – così contraria alla nostra esperienza – per cui se le stelle fisse si estendono lontano fino ad una illimitata distanza, l’intero cielo dovrebbe risplendere di luce. Assumiamo, per esempio, che lo spazio sia trasparente nella misura per la quale di ogni 800 raggi emessi da Sino, solo 799 sopravvivono dopo aver attraversato una distanza pari a quella che ci separa da Sirio. Questo piccolo tasso di assorbimento in un universo infinitamente popolato di stelle è più che sufficiente per realizzare le condizioni osservate sulla Terra […] Possiamo tranquillamente dire, dato il tasso di assorbimento che abbiamo assunto, che tutte le stelle poste ad una distanza più di 30.000 volte superiore a quella di Sirio non contribuiscono affatto alla luminosità del cielo. [citato da Parini]

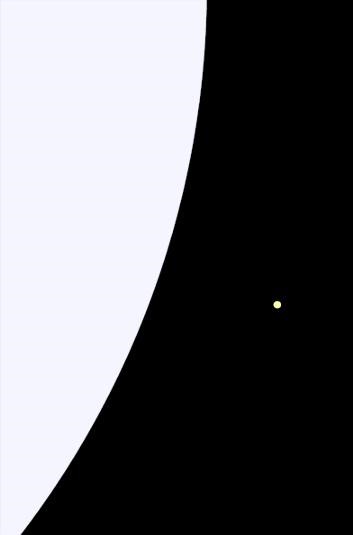

Bucce sferiche di piccolo spessore d, contenenti stelle e poste a differenti distanze, r1 ed r2, dal Sole assunto come centro

Come si può constatare si tratta delle medesime argomentazioni già incontrate con qualche piccola variante che discendeva dalla maggiore conoscenza del cielo realizzatasi negli ottanta anni che sono passati. Ed anche la spiegazione del perché non siamo abbagliati dalla luminosità di tutte quelle stelle è la medesima. Le novità riguardano: la molto maggiore distanza delle e tra le stelle; le stelle non più considerate distribuite uniformemente ma organizzate in gruppi come la Via Lattea di modo che si potrebbe parlare di bucce sferiche piene di galassie piuttosto che di stelle, anche se la conclusione sarebbe la medesima; l’eventualità prospettata dell’esistenza di corpi celesti a noi invisibili che abbiano caratteristiche completamente diverse da quelle che conosciamo ed abbiano addirittura una luce con proprietà diverse.

Al centro della figura è riportata la nostra galassia vista di profilo. Al bordo di essa, dove è indicato arrivare la luce delle stelle, vi è il sistema solare. Le bucce sferiche contengono ora ammassi stellari piuttosto che stelle singole.

Un’ultima considerazione va fatta sull’ipotesi della materia interstellare che assorbirebbe la luce delle stelle. Riguarda ciò che la termodinamica scoprirà di lì a poco. Una data massa non può assorbire energia all’infinito. Se assorbe radiazione deve anche emetterne. Ciò discenderà naturalmente dai lavori di Helmholtz e Clausius della metà dell’Ottocento. Quindi, intorno al 1850, la soluzione proposta per risolvere il problema da Chéseaux ed Olbers diventa impraticabile ed il paradosso resta in piedi.

GLI SPETTRI DELLE STELLE

A metà Ottocento, in piena rivoluzione industriale, la scienza e la tecnologia avevano fatto passi da gigante. Si realizzava la costruzione di strumentazione sempre più raffinata e si finanziavano laboratori sempre più attrezzati. Siamo negli anni in cui Foucault (1850) e Fizeau (1849) eseguirono le misure di velocità della luce, in cui lo stesso Foucault offrì la prima prova meccanica della rotazione terrestre con il famoso esperimento del pendolo nel Pantheon di Parigi (1851), in cui si affermava la teoria ondulatoria della luce, in cui stava per essere riconosciuta la luce come un onda elettromagnetica (Maxwell 1864) ed in cui Doppler scoprì l’effetto che porta il suo nome (1842). Mentre il francese J.P. Niepce (1765-1833) aveva già scoperto la tecnica fotografica. Per quel che ci interessa direttamente ora, in quegli anni vi furono i fondamentali lavori di spettroscopia di Kirchhoff (1824-1877) e R.W. Bunsen (1811-1899).

A partire dal 1859 Kirchhoff e Bunsen gettarono le basi della moderna spettroscopia. Kirchhoff, nel 1857, riprese alcuni studi ed esperienze realizzati nel 1802 dal chimico-fisico inglese William Hyde Wollaston (1766 – 1828) e nel 1814 dal fisico ed astronomo tedesco Joseph von Fraunhofer. Osservando lo spettro del Sole con un prisma perfezionato, Wollaston aveva notato in esso sette righe scure che solo annotò senza studiare il fenomeno in modo particolare.

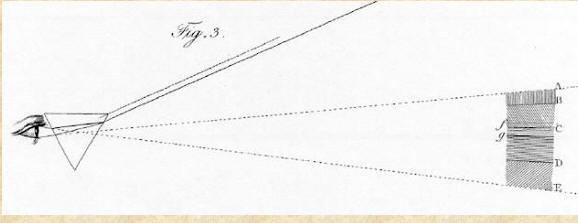

La semplice osservazione di Wollaston mediante un solo prisma.

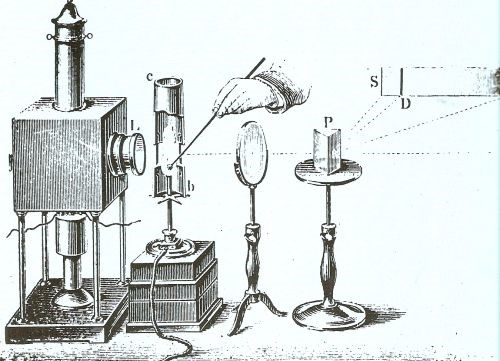

Dimostrazione del funzionamento di un primitivo spettroscopio

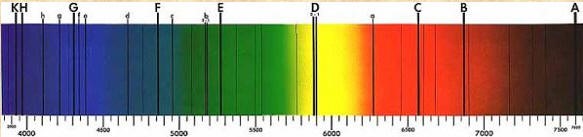

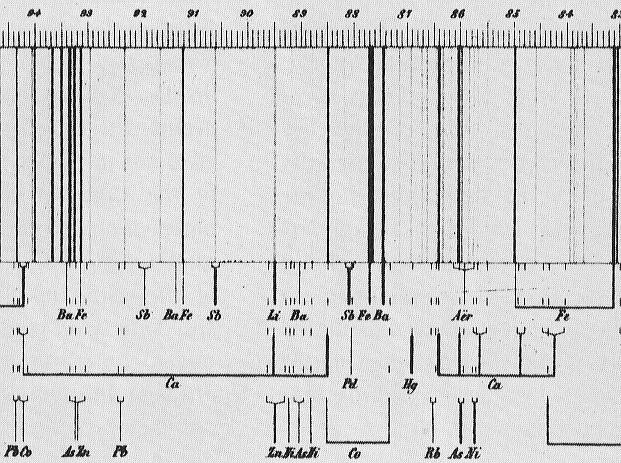

Fraunhofer, che aveva inventato il reticolo di diffrazione, uno strumento molto più perfezionato per osservare e studiare lo spettro solare, arrivò ad individuare in tale spettro 570 sottili linee nere che lo attraversavano, ancora oggi note come linee di Fraunhofer, e le studiò sistematicamente, classificandole (chiamandole con lettere maiuscole e minuscole a seconda dell’intensità) e misurandone la lunghezza d’onda. In definitiva realizzò la prima carta dello spettro solare. Con quel reticolo, che ha un maggiore potere risolutivo del prisma e permette una migliore separazione della luce, fece le prime determinazioni della lunghezza d’onda dei vari colori dello spettro. E’ da notare che Fraunhofer osservò che l’introduzione di un sale (come il sodio) nella fiamma faceva comparire nello spettro delle righe brillanti e che la riga gialla, caratteristica del sodio che brucia, si divideva in due linee quando la radiazione era fatta passare attraverso un prisma con migliori caratteristiche (Fraunhofer non sapeva ancora che quella doppia riga gialla era caratteristica del sodio: egli la otteneva osservando lo spettro prodotto da una candela, da una lampada ad elio e da una lampada ad alcool). Successivamente Fraunhofer cercò queste due righe gialle nello spettro solare ma non le trovò: al loro posto vi erano invece due linee nere che chiamò D. La cosa lo colpì ma non riuscì a comprendere cosa accadeva. Passando ad osservare gli spettri di vari pianeti e stelle, scoprì nello spettro di Venere alcune righe presenti nello spettro del Sole e che gli spettri di Capella, Betelgeuse, Polluce e Procione avevano spettri simili a quello del Sole.

Le righe nere di Fraunhofer che solcano lo spettro solare (da pil.phys.uniroma1.it/…/CorsoStrutturaAtomi).

Dopo la scoperta del britannico Draper (1811 – 1882) che corpi solidi, portati all’incandescenza, emettevano anch’essi uno spettro, le ricerche si ampliarono ma le osservazioni risultavano disturbate dalla fiamma necessaria a portare all’incandescenza tali corpi (Draper, per portare all’incandescenza i corpi, usava una fiamma brillante e, per questo, sosteneva che gli spettri delle sostanze solide fossero continui mentre era la fiamma brillante che originava lo spettro continuo. Draper sembra sia stato il primo, nel 1840, a fotografare gli astri. Dopo di lui de La Rue nel 1853 e via via la tecnica si diffuse con grande successo). Fu il chimico tedesco Bunsen che fece la scoperta che risolse tale problema: utilizzando il gas illuminante, installato nel suo laboratorio nel 1855, si ottiene una fiamma non molto luminosa ma ad alta temperatura. Nacque così il becco Bunsen, con il quale si possono ottenere gli spettri dei soli corpi portati all’incandescenza senza interferenze da parte della fiamma che non ha un proprio colore specifico. Si vide allora che gli spettri delle sostanze solide sono discontinui.

Kirchhoff, che nel 1859 aveva iniziato a lavorare nel laboratorio di Bunsen, osservò che, se sul becco Bunsen si fa bruciare del sodio, lo spettro ottenuto presenta due righe gialle che coincidono esattamente con le più evidenti delle linee scure presentate dallo spettro solare (riga D). Se poi si osserva quest’ultimo spettro, interponendo tra la luce del Sole ed il prisma un Bunsen con del sodio che brucia, non appare più la riga D dello spettro solare ed al suo posto si presentano le righe gialle del sodio. Quest’ultimo fenomeno si verifica solo quando la luce solare è molto attenuata, in caso contrario si continua a vedere la linea D. Lo stesso fenomeno si può osservare mantenendo constante l’intensità della luce solare ed aumentando o diminuendo la temperatura della fiamma del Bunsen. L’insieme di questi fenomeni fece comprendere a Kirchhoff il significato dello spettro solare ed in particolare delle sue linee oscure: la superficie del Sole (fotosfera) emette radiazioni di tutti i colori e l’atmosfera di gas incandescenti del Sole (cromosfera e corona), molto meno calda della fotosfera, assorbe una parte delle radiazioni emesse dalla stessa fotosfera ed in particolare quella che è emessa dagli elementi che costituiscono l’atmosfera solare. Lo stesso Kirchhoff scriveva:

Le fiamme colorate nei cui spettri si presentano linee brillanti e marcate [spettro di emissione], indeboliscono talmente i raggi del calore di queste linee, quando passano attraverso di esse, che, al posto delle linee brillanti, compaiono linee scure [spettro di assorbimento] quando si colloca dietro la fiamma una fonte di luce di sufficiente intensità e nel cui spettro mancano queste linee. Concludo quindi che le linee scure dello spettro solare non sono prodotte dall’atmosfera terrestre [ipotesi avanzata da qualcuno] ma nascono dalla presenza nella infuocata atmosfera del Sole di quelle sostanze che, nello spettro di una fiamma, presentano le linee brillanti nella stessa posizione(9).

Spettro di emissione del sodio con la caratteristica linea gialla

Spettro di assorbimento del sodio. La riga gialla di emissione che diventa nera in assorbimento

Conseguenza immediata di queste osservazioni fu l’enunciato del cosiddetto principio di inversione secondo il quale una sostanza assorbe le stesse radiazioni che è in grado di emettere(10). Ma, al fine dei nostri scopi, il risultato più importante fu conseguito da Kirchhoff nel 1859 quando definì il corpo nero, dallo studio del quale discenderanno clamorose conseguenze (nascita dei quanti).

Le ricerche proseguirono e presto i due scienziati tedeschi compresero un fatto fondamentale. Riuscirono a stabilire la presenza sul Sole di alcuni elementi: confrontando le righe che compongono lo spettro solare con quelle, ottenute in laboratorio, per elementi noti (all’esistenza di un dato insieme di righe nello spettro corrisponde sempre la presenza di un dato elemento)(11). Questa scoperta era nata da una congettura del 1823 di John Herschel.

Gli studi in questo campo portarono a stabilire senza ombra di dubbio che ciascun elemento aveva un suo spettro che differiva da tutti gli altri. Se si aveva un composto, lo spettro che veniva fuori era semplicemente la sovrapposizione degli spettri dei vari elementi che lo costituivano. Per questa via si scoprirono nuovi elementi poiché in dati composti comparivano serie di linee che non erano mai state osservate per nessun elemento. Esemplifico con gli spettri di due elementi, il primo dell’elio (elemento prima sconosciuto e che, appunto, fu trovato per via spettroscopica, analizzando lo spettro solare), il secondo del neon.

Poiché i gas dell’atmosfera solare sono più freddi di quanto non lo sia la parte più interna del Sole, un dato elemento dell’atmosfera solare è incapace di rimpiazzare con la sua propria radiazione i raggi che ha assorbito. Ed è in questo modo che nascono le linee oscure nell’atmosfera solare e ciò spiega anche l’assenza nella luce di radiazioni di elementi dati e la loro presenza nel Sole. In definitiva Kirchhoff aveva scoperto alcune cose di grande importanza. Era partito da osservazioni apparentemente semplici come quella che non si possono distinguere gli oggetti contenuti in un recipiente a temperatura uniforme usando la radiazione emessa dal recipiente stesso. Se, ad esempio, guardiamo l’interno di un forno in cui vengono cotti dei vasi di colori diversi, si vede una colorazione rossastra uniforme. Come nasce tale fenomeno ? Consideriamo due vasi, A e B, nel forno. Se l’intensità della luce che lascia A in direzione di B fosse maggiore di quella che va da B ad A, si avrebbe come risultato che dell’energia va da A a B con la conseguenza che B aumenterebbe di temperatura. E ciò, in assenza di lavoro fatto dall’esterno, risulta essere una violazione del Secondo Principio della termodinamica (si noti come la termodinamica entri con autorevolezza all0interno di questioni di astronomia e come pian piano tutte le conoscenze fisiche vadano a confluire nella spiegazione di ogni fenomeno). Con queste premesse Kirchhoff immaginò il Sole come un corpo sferico caldo avvolto da successivi strati di gas che in qualche modo filtravano la radiazione proveniente da tale corpo e descrisse il trasferimento di energia dall’interno all’esterno in base alla termodinamica.

LA VELOCITA’ DELLE STELLE

I risultati qui esposti possono essere considerati il fondamento dell’astrofisica e della fisica teorica. Da questo momento si iniziò lo studio sistematico degli spettri di varie stelle ed il risultato di queste osservazioni portò a riconoscere che tutti gli elementi in esse presenti sono gli stessi che conosciamo sulla Terra. Lo studio di tali spettri permise a Norman Lockyer, nel 1868, di scoprire sul Sole l’elemento elio che esiste anche sulla Terra senza essere mai individuato (sarà trovato nel 1895 da William Ramsay) inoltre, nel 1952, su alcune stelle giganti rosse, Paul W. Merrill trovò il tecnezio, elemento non esistente in natura sulla Terra perché estremamente instabile, scoperto da Emilio Segrè nel 1937. Ancora a Lockyer è dovuta la scoperta che le protuberanze solari, da lui osservate nell’eclisse totale visibile in India nel 1868, sono costituite da gas molto caldi. Durante la medesima eclisse scoprì l’esistenza di quello strato del Sole, che si trova sopra la fotosfera, da lui battezzato cromosfera.

La presenza negli spettri di determinati elementi o altri in maniera dominante, fa suddividere le stelle in classi spettrali differenti O, B, A, F, G, K, M … e ciascuna classe è ulteriormente suddivisa con numeri che vanno da 0 a 9 (il Sole è nella classe G 2). A queste classi si aggiunsero nel 1924 la R, S, N (le R sono stelle giallo-arancio-rosso come le G, K ed M ma contenenti molto più carbonio ed aventi una temperatura molto più fredda, 2.500 °K; le N sono stelle giallo-arancio-rosso come le G, K ed M ma contenenti molto più carbonio ed aventi una temperatura ancora più fredda, 2.000 °K; le S sono stelle rosse come le M ma contenenti più ossido di zirconio ed una temperatura al limite del visibile, ≤ 2.000 °K). La suddivisione iniziale (senza le R, S ed N) fu fatta da E. Pickering (1846-1919) ed accettata da un Congresso internazionale nel 1910. Tornando agli spettri delle stelle, essi, opportunamente analizzati, sono in grado di fornirci molte altre informazioni: sulle condizioni fisiche sulla superficie delle stelle, sulla temperatura e densità del materiale gassoso che produce le linee dello spettro e, analizzando con attenzione le lunghezze d’onda in corrispondenza delle quali vi sono righe, sul movimento delle stelle medesime mediante l’effetto Doppler classico.

| CLASSE SPETTRALE | TEMPERATURA °K | COLORE | COMPOSIZIONE APPROSSIMATIVA |

| O | Oltre 50 000 | Azzurro | elio |

| B | 25 000 | Azzurro-bianco | elio e ossigeno |

| A | 20 000 | Bianco | idrogeno |

| F | 14 600 | Bianco-giallo | idrogeno e calcio |

| G | 6 000 | Giallo | calcio e ferro |

| K | 5 100 | Arancio | idrogeno, calcio e metalli |

| M | 3600 | Rosso | calcio, titanio e molecole |

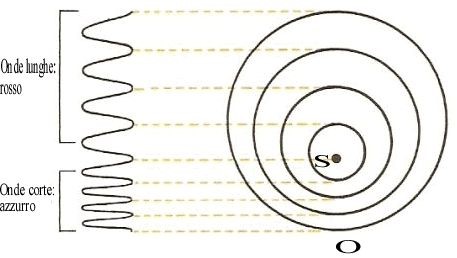

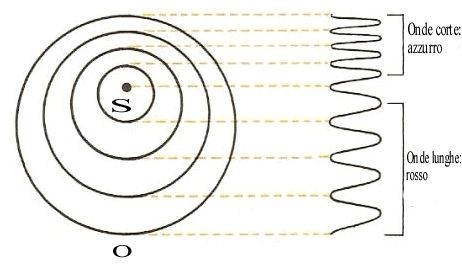

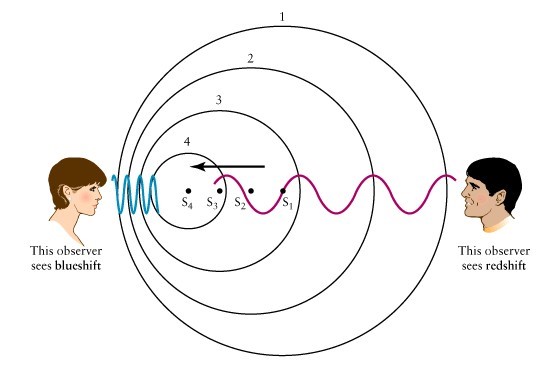

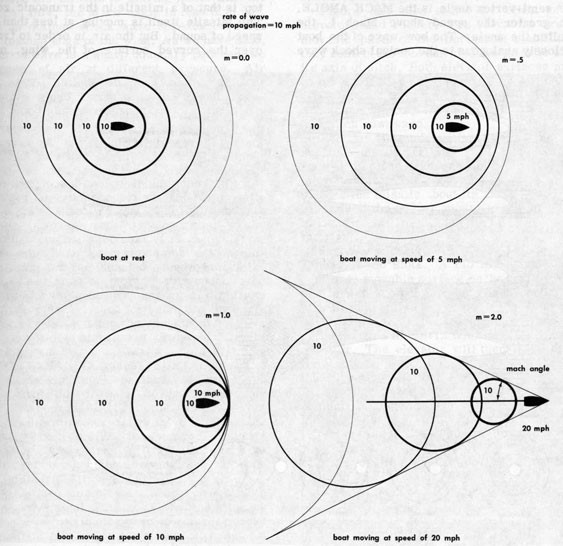

Per capire come sia possibile con l’effetto Doppler studiare il moto delle stelle, consideriamo una sorgente luminosa S, a questo punto considerata come costituita da onde, che si muove verso un osservatore O. L’effetto Doppler, discusso con ogni dettaglio nel link proposto, consiste in un addensamento delle onde nel verso del moto (e conseguente rarefazione in verso opposto).

Nel caso S si allontanasse da O la situazione sarebbe invertita.

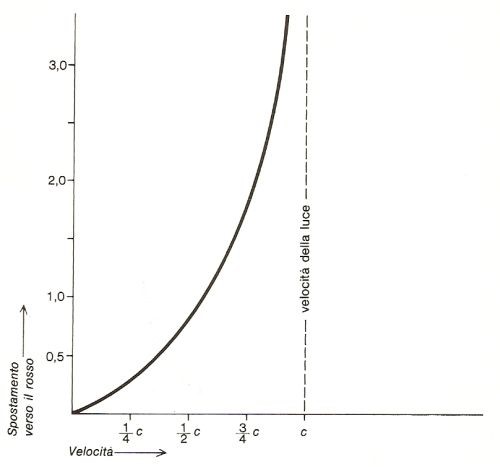

Ciò vuol dire che un osservatore è in grado di stabilire se una sorgente luminosa è in avvicinamento o in allontanamento attraverso il colore che percepisce. Inoltre, più il colore tende al rosso, più la sorgente si allontana velocemente da O. Più il colore tende verso l’azzurro, più la sorgente si avvicina velocemente. Naturalmente vi sono tutte le situazioni intermedie, tra le quali il non osservare spostamenti né verso il rosso, né verso l’azzurro che vuol dire che S è immobile rispetto ad O(12).

Se v è la velocità della sorgente O, la variazione Δλ della lunghezza d’onda λ, per unità di λ, vale:

Δλ/λ = v/c

dove c è la velocità della luce.

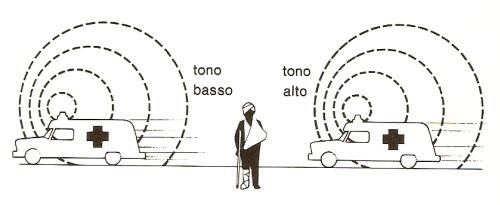

Occorre notare che l’effetto Doppler per la luce è molto meno evidente di quello che si sperimenta quotidianamente con il suono (l’avvicinarsi ed allontanarsi di una ambulanza) poiché, per dare dei numeri e riferendoci all’allontanamento, una velocità di 30 km/sec (cioè di 100 mila km/h) fa variare la lunghezza d’onda di appena un decimillesimo e d’altra parte occorre che una sorgente si allontani ad una velocità dell’ordine della metà di c perché la radiazione blu della sorgente appaia rossa all’osservatore immobile. Altri numeri riguardano le velocità delle stelle e degli ammassi stellari: quella delle stelle è relativamente piccola e può variare dai 10 ai 200 km al secondo, mentre quella delle galassie e delle nebulose raggiunge velocità che variano d alcune migliaia di chilometri al secondo fino a 60 000 km/sec. Ma, attenzione, quando si entra a studiare questioni che implicano velocità di questo tipo, velocità da comporre con quelle della luce che arriva a noi, i problemi non sono più descrivibili in questo modo semplice. Diventa indispensabile la correzione relativistica dell’effetto Doppler.

Effetto Doppler acustico

ENERGIA DAL SOLE E DALLE STELLE

Riguardo alla temperatura delle stelle, fino al 1843, vi era la convinzione diffusa che la luce ed il calore delle stelle fossero due fenomeni differenti. Fu l’opera di Macedonio Melloni, il Newton del calore, a stabilire che i sue fenomeni non sono separabili ma che il calore deve essere rintracciato oltre il visibile, nell’infrarosso (chiamata radiazione calorifica). Per misurare la temperatura delle stelle occorre il bolometro, un termometro elettrico realizzato da S.P. Langley nel 1878 (successivamente sostituito da strumenti più sensibili basati sull’effetto fotoelettrico e sul fenomeno della pressione di radiazione – 1895). Misure pionieristiche di temperatura delle stelle erano comunque state fatte fin dal 1868 dall’astronomo inglese William Huggins (1824-1910) che aveva già scoperto la natura gassosa di alcune nebulose (a cominciare da una della costellazione del Drago che osservò nel 1864 e che non presentava lo spetto di assorbimento), misurato per la prima volta la velocità radiale di alcune stelle, individuato nello spettro di una nova le righe (una variazione di luminosità associato per la prima volta ad altro fenomeno fisico) dell’idrogeno ed applicato sistematicamente la tecnica fotografica allo studio degli astri (1863). Le misure di Huggins erano state fatte con la termopila di Melloni (una termocoppia moltiplicata per migliaia di saldature). Queste scoperte, in particolare quelle di temperatura riferite ad esempio al Sole, aprivano un’altra classe di problemi: come è possibile che il Sole (e quindi le stelle), costituito con gli stessi elementi dei pianeti, da milioni e milioni di anni riesca ad inviare una tale quantità di energia senza apparente consumo, come la termodinamica ormai richiedeva ? Lo stesso Kelvin era intervenuto sulla questione con un articolo del 1854, On the Mechanical Energies of the Solar System nel quale si sosteneva che serviva una teoria che rendesse conto della perdita di energia del Sole, corpo caldo, senza che esso si consumasse in tempi rapidi (pochi minuti o al massimo pochi anni). Se il calore prodotto dal Sole proveniva da una combustione chimica (carbone), Kelvin calcolava che una massa di dimensioni pari a quella attuale del Sole, si consumerebbe, bruciando, in 8000 anni. Se il Sole avesse avuto nelle epoche remote un tale livello di combustione, esso avrebbe dovuto avere 8000 anni fa un diametro doppio, una potenza calorifica quadrupla e una massa 8 volte maggiori di quelle attuali [citato da Bellone]. La soluzione del problema per Kelvin era analoga a quella di Wollaston: doveva trattarsi della combustione di meteore attratte dal Sole per la sua enorme gravità (teoria gravitazionale del calore solare) che però prevedeva la caduta sul Sole di tante meteore in grado di creare sul Sole una cappa di 30 metri ogni anno (principio di Joule). Un’alternativa era la caduta a spirale delle meteore che avrebbe prodotto energia cinetica sufficiente a sviluppare poi il calore necessario. Queste elaborazioni che oggi fanno sorridere erano anche alla base di dispute teologiche sulla nascita della vita e risultarono anche un ostacolo alle teorie evoluzionistiche avanzate da Darwin nel 1859: i tempi giganteschi già prospettati nel Settecento per l’evoluzione geologica della Terra, dovevano essere riportati a qualche migliaio di anni, con somma soddisfazione dei fondamentalisti biblici. L’argomento era talmente sentito che Kelvin vi tornò su con un altro articolo del 1862, On the Age of the Sun’s heat nel quale rivedeva i conti sulla luce e calore che il Sole ci aveva inviato. Questo tempo era ora valutato in non più di 100 milioni di anni, comunque non sufficienti, secondo Kelvin, per quelle evoluzioni sbandierate da più parti che richiedevano almeno il triplo di tempo. Di fronte ad una teoria come quella di Kelvin, Darwin, nella sesta edizione de L’origine della specie, poté rispondere a ragione che vi era la possibilità, nel passato, di cambiamenti di condizioni fisiche molto più rapidi e violenti dell’epoca in cui vivevano. Nel dibattito vi fu anche un intervento, di ben altro significato, di Helmholtz. Riporto quanto sostenuto da Helmholtz come introdotto da Bellone, avvertendo che non si trattava di una ipotesi come un’altra ma di una elaborazione matematica molto rigorosa e precisa che non è il caso riportare qui (si può vedere ancora Bellone).

In una conferenza del 1854, Ueber die Wechselwirkung der Naturkrdjte und die darauj bezuglichen neuesten Ermittelungen der Physik (Sull’azione reciproca delle forze naturali e sulle più recenti determinazioni della fisica che ad essa si riferiscono), Helmholtz, dopo aver ricordato che le indagini spettroscopiche sui corpi celesti confermavano l’idea che le medesime leggi fisiche agissero sia sulla Terra, sia nello spazio cosmico, notava che «le leggi fisico-meccaniche sono come il telescopio del nostro occhio mentale: esse penetrano nella notte più remota del passato e del futuro». Era quindi essenziale servirsi di quelle leggi per spiegare l’origine del calore solare, in un quadro evolutivo che prendeva le mosse dal processo di condensazione della nebulosa primitiva dal quale era sorto il sistema di pianeti del Sole. In quel processo, secondo Helmholtz, «la storia dell’umanità finora svoltasi è stata … solo una corta ondata nell’oceano dei tempi». In base al principio di conservazione dell’energia, poi, le forze operanti nel Sole avrebbero lavorato «ancora per tempi incommensurabilmente lunghi».

Ma anche questi tempi incommensurabilmente lunghi risultavano brevi per l’evoluzione darwiniana e geologica. Vi era implicita la condanna di Kelvin (1862) di ancora pochi milioni di anni per la vita sulla Terra, a meno che, come egli scrisse, non fossero state scoperte sorgenti ancora oggi ignote.

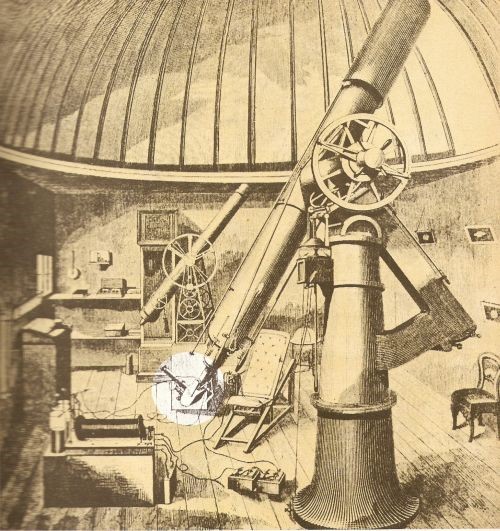

Uno spettroscopio (nel circoletto bianco) collegato ad un telescopio rifrattore dall’astronomo britannico W. Huggins nel 1860. Si noti sulla sinistra in basso la presenza di un rocchetto di Ruhmkorff, uno strumento che nasce in ambito elettromagnetico, che mostra l’uso integrato di ogni mezzo a fini di ricerca. Nel 1862 furono realizzati degli spettrografi particolarmente costruiti per lo studio degli spettri delle stelle. Nella figura seguente è riportato lo spettrografo usato da G.B. Donati a Firenze nel 1862.

Tornando a Kirchhoff, i suoi lavori successivi furono dedicati a tracciare una mappa dello spettro solare assegnando ad un gran numero di linee gli elementi chimici che le generavano.

La mappa solare di Kirchhoff (1863) con il riconoscimento nello spettro del Sole di numerosi elementi, tra cui il ferro.

Il fisico svedese A. J. Ångstrom (1814-1874) che nel 1862 aveva individuato l’idrogeno nel Sole (ma occorrerà arrivare al 1920 per scoprire che l’idrogeno è molto abbondante sul Sole), nel 1868 costruì un’altra mappa del Sole e fu il primo a descrivere le radiazioni solari in termini di lunghezze d’onda. Nello stesso anno di Ångstrom, fu ancora W. Huggins a dirigere lo spettroscopio verso Sirio ed altre stelle (30) applicando a queste osservazioni l’effetto Doppler. Con ciò scoprì che le linee spettrali si spostavano come conseguenza dello spostamento della stella Sirio della quale valutò una velocità di allontanamento di 47 Km/sec. Fu la prima volta che si riuscì a misurare la velocità radiale di una stella. Siamo in quel 1868 che vide altri successi astronomici. L’eclisse solare del 1860 (visibile in Spagna ed osservata anche da Angelo Secchi che fu un grande astronomo con esperienza di 40 anni di osservazioni. A lui si deve fra l’altro il riconoscimento dell’esistenza delle atmosfere dei pianeti), e successivamente quella del 1869 (visibile nel Kentucky negli USA), avevano provato definitivamente le ricerche e teorie di Kirchhoff e Bunsen. Durante l’eclisse la fotosfera solare permise di vedere, in luogo delle consuete linee oscure, le linee brillanti dello spettro emesse dall’atmosfera solare(13). Tra l’altro si capì che le protuberanze sono fenomeni reali (eruzioni o esplosioni che si estendono nello spazio a distanze pari a decine di volte il diametro della Terra) e non effetti luminosi e si aprì la strada ai lavori dell’astronomo americano C.A. Young che nel 1870 capì che era nella cromosfera che si originava l’inversione dello spettro, le righe oscure di Frahunhofer, e per questo la chiamò strato invertente. Studiando lo spettro della cromosfera Young scoprì una linea di emissione verde che non risultava da nessun’altra parte. Si credette di aver scoperto un nuovo elemento che fu battezzato coronium. Ci vollero 60 anni perché B. Edlén nel 1942 scoprisse che si trattava di una riga del ferro fortemente ionizzato in stati normalmente interdetti (qui si verificò un errore analogo a quello di Fermi e collaboratori del 1934, quando credettero di aver scoperto i nuovi elementi Ausonio ed Esperio. Come Young non pensarono di cercare in un luogo distante della tavola periodica rispetto a quello che ipotizzavano). ). La vicenda del coronium fa il paio con quella di un altro elemento stellare, il nebulio che nasceva da due particolari linee spettroscopiche ignote precedentemente. J. S. Bowen scoprì nel 1928 che si trattava di transizioni dell’ossigeno ionizzato due volte tra uno stato metastabile (in condizioni normali non consentito) ed uno normale. Sempre Young, puntando lo spettroscopio sul bordo del Sole durante l’eclisse del 1870 in Spagna, riuscì a osservare per qualche secondo lo spettro di emissione della sua superficie privo dello spettro continuo di assorbimento della fotosfera. Si inaugurava così la possibilità dei cosiddetti spettri-lampo. Stava nascendo l’astrofisica che poneva molti problemi a tutta la fisica e che riuscì a spiegare molti dei fenomeni osservati solo con l’avanzamento simultaneo di altre ricerche in campi differenti: termodinamica, struttura atomica, ionizzazione, onde radio, fisica quantistica, relatività ristretta, relatività generale, fisica nucleare, fisica dei raggi cosmici, fisica delle particelle, chimica, matematica. Un incastro impressionante da richiedere una preparazione di alto livello per affrontare questi studi. Insomma la spettroscopia mieteva successi, molto più rapidi e penetranti di quanto non facesse l’esplorazione ottica dello spazio. Ma cos’è uno spettro ? Nessuno lo sapeva o era in grado di intuire. Quindi vi era una sorta di peccato originale a monte che rendeva un poco instabile l’edificio delle osservazioni.

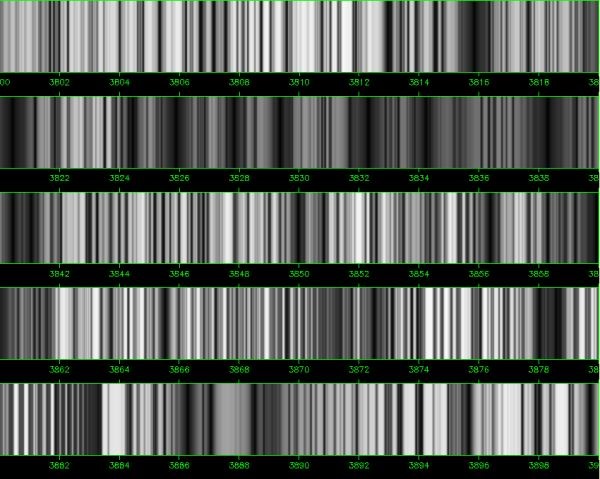

Una piccola parte dello spettro solare, tra i 3800 Å (in alto a sinistra) ed i 3900 Å (in basso a destra), che andrebbe letto tutto su una linea. Lo spettro solare in tutto il visibile lo si può trovare all’indirizzo: http://chinook.kpc.alaska.edu/~ifafv/lecture/fraunhofer.htm

Lo spettro solare nel visibile (anche qui ogni linea dovrebbe essere messa a fianco dell’altra).

Fino a pochi anni prima sarebbe stato impensabile capire, ad esempio, di quali elementi fossero composti Sole, stelle e pianeti. Ora con la spettroscopia diventava possibile descrivere l’universo in modo più compiuto e con l’effetto Doppler capirne meglio la meccanica. E si era capito che l’universo aveva una profonda unità materiale: sul Sole, su Sirio, sulla Luna vi erano gli stessi elementi terrestri. Trionfo ancora di Galileo, del suo Nuncius Sidereus. Non vi sono due mondi separati dal cielo della Luna, ma un solo mondo!

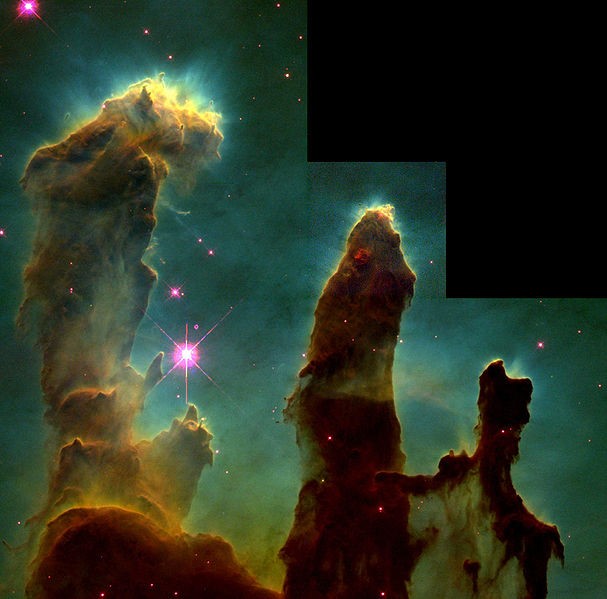

L’EVOLUZIONE DELLE STELLE

Abbiamo fino ad ora visto l’accumularsi di dati sulla struttura delle stelle. In tutti i laboratori si studiava tutto il possibile sulle stelle ma mancava un filo conduttore che legasse fatto a fatto e permettesse una comprensione più matura. Aveva iniziato Herschel sul finire del Settecnto. Egli, dopo l’osservazione di vari gruppi di stelle e nebulose con le forme più varie ed addirittura incredibili, avanzò l’ipotesi, sviluppata a partire dal 1789, che le stelle avessero una evoluzione. Dalle sue osservazioni sembrava venir fuori che le stelle fossero a differenti gradi del loro sviluppo. Il problema che egli si poneva era di collegare cronologicamente quelli che riteneva diversi gradi di sviluppo. I tempi di tale presunta evoluzione, egli sosteneva, sono immensi ma noi possiamo usufruire di molte migliaia di esempi offerti nel cielo alla nostra osservazione. Il 13 novembre 1790, Herschel osservò la nebulosa planetaria all’epoca nota come H IV.69 (l’odierna NGC 1514) che ha una stella centrale estremamente luminosa, il che lo convinse che le nebulose planetarie sono materiali nebulosi (gas o polveri) associati ad una stella centrale e non ammassi non risolti come si pensava in precedenza. Questa osservazione lo convinse che probabilmente una stella o un aggregato di stelle nasceva da una nebulosa mentre il contrario non gli sembrava fosse sostenibile. Tra il 1811 ed il 1814 elaborò ed enunciò la sua teoria in due articoli(14) secondo la quale tutto inizia con una diffusa nebulosa con le parti più dense che fungono da centri di condensazione gravitazionale, si passa quindi ad una nebulosa più densa, quindi ad un compatto gruppo di stelle, infine ad una stella unica o ad un gruppo stellare. Questa idea ebbe un successivo sostegno (1868) da parte di Angelo Piazzi che catalogò le stelle in quattro tipi: quelle bianco azzurre, con intense righe di idrogeno; quelle gialle come il Sole, con righe di vari elementi chimici; quelle rosse come Betelgeuse che presentavano uno spettro a bande; quelle che si ottengono dal terzo tipo eliminando alcune righe oscure. Questa classificazione, accettata da molti astronomi, suggeriva in qualche modo una evoluzione delle stelle consistente nel passaggio da un gruppo ad un altro.

Finalmente arriviamo a coloro che svilupparono in modo compiuto l’idea di evoluzione stellare: il britannico J. N. Lockyer, il danese E. Hertzsprung (1873-1967), lo statunitense H. N. Russel (1877-1939), il britannico A. Eddington (1882-1944), lo statunitense E. C. Pickering (1846-1919) ed altri ancora più vicini e contemporanei a noi. Non è possibile qui dare un’informazione, foss’anche limitatissima, di tutto ciò che è stato fatto nel Novecento perché, come accennato, non si tratterebbe di una storia dell’astrofisica ma di tutta la fisica. Mi limito a continuare a cercare di capire le linee di pensiero degli astrofisici sull’evoluzione stellare fin dove è possibile senza mettere in gioco altre conoscenze complesse e senza banalizzare delle ricerche che per essere davvero capite abbisognano di molte conoscenze di base.

Il britannico Lockyer, pur distante dalla fisica nucleare, sviluppò sull’evoluzione stellare una posizione in contrasto con quella della gran maggioranza degli astrofisici. Secondo il nostro occorreva ammettere che l’evoluzione dovesse essere accompagnata da una trasmutazione degli elementi chimici perché questa sembrava l’unica strada per spiegare molti aspetti dell’osservazione e delle teorie sviluppate in proposito. Le tappe evoluzionistiche che propose sono le seguenti. Una stella nasce come un oggetto freddo da sciami di meteoriti; dalle loro collisioni si produce tanto calore da portare la stella in evoluzione fino ad una data classe spettrale verso la zona delle stelle rosse. A questo punto è la gravità che la fa condensare sempre più con ulteriore condensazione e ulteriore sviluppo di calore finché la stella non acquista una classe spettrale più vicina all’azzurro (completa vaporizzazione). A questo punto non vi sono piuù collisioni e la gravità ha esaurito il suo compito, per cui la stella inizia a raffreddarsi percorrendo un cammino opposto al precedente fino a diventare un corpo solido, freddo e non più in grado di dare luce e calore. A questo punto la stella è morta. In tali variazioni di temperatura si avrebbero le stramutazioni chimiche che Lockyer immaginava.

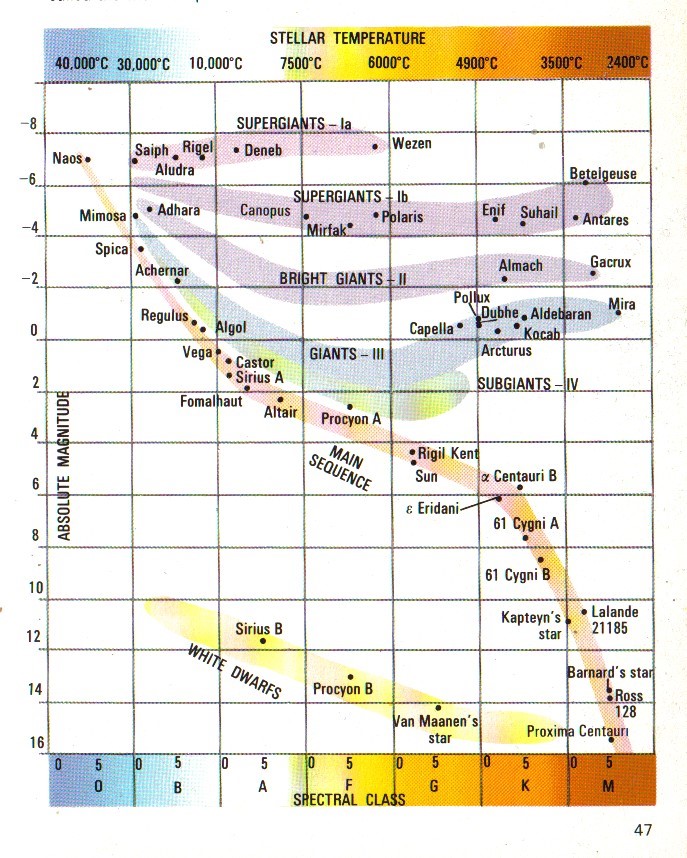

Il contributo successivo viene sia da Hertzsprung che da Russel che, tra il 1905 ed il 1912, classificarono le stelle in giganti e nane. Ai due è dovuto il diagramma H-R (dalle iniziali dei loro cognomi) che mette in relazione la classe spettrale(15) (si veda la tabella fornita in precedenza) di una stella (in ascisse) e la sua grandezza assoluta(16) (in ordinate). Si deve osservare che dietro la classe spettrale vi è il colore e la temperatura superficiale(17) delle stelle che si determinano indirettamente a partire dall’intensità delle linee spettrali. D’altra parte, anche ad occhio nudo, oltre alle differenze di luminosità tra le stelle si possono notare anche le diverse colorazioni superficiali. Si ha a che fare con stelle azzurre, bianche, gialle, rosse, … E, per altri versi, sappiamo che dietro ogni colore vi è una temperatura. Si può vedere la tabella fornita in precedenza e confrontarla con la seguente che fornisce alcune magnitudo relative ed assolute

| STELLA | MAGNITUDO APPARENTE | DISTANZA (parsec) | MAGNITUDO ASSOLUTA | LUMINOSITA’ (rispetto al Sole) |

| Sole | – 26,7 | 4.84813×10-6 | 4,8 | 1 |

| Sirio | -1,4 | 2,64 | 1,5 | 22,5 |

| Arturo | – 0,05 | 11,25 | -0,31 | 114 |

| Vega | 0,03 | 7,76 | 0,58 | 50,1 |

| α Vergine | 0,98 | 80,5 | – 3,6 | 2 250 |

| α Cygni | 1,3 | 3,30 | – 8,7 | 250 000 |

| Barnard | 9,5 | 1,82 | 13,2 | 1/2310 |

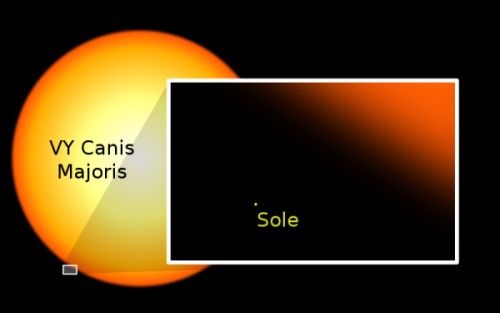

Riporto di seguito il diagramma H-R in cui sono riportate varie stelle secondo il criterio annunciato. In basso vi sono le nane bianche (white dwarfs), vi è quindi la sequenza principale (main sequence) in cui vi è il Sole, ancora più su vi sono, tra le altre, le giganti rosse tra cui vi è Aldebaran, le supergiganti rosse tra cui vi è Betelgeuse, le supergiganti bianche tra cui vi è Deneb (α Cygni)(18) … fino alle supergiganti azzurre come Saiph (κ di Orione).

http://bdaugherty.tripod.com/gcseAstronomy/stars.html

Vi sono alcune considerazioni da fare. Intanto la suddivisione delle stelle in nane e giganti fu fatta nel 1905 da Hertzsprung che si accorse che quando si ha a che fare con uno spettro con righe molto sottili e definite la stella a cui appartiene tale spettro ha una magnitudine assoluta molto maggiore delle altre. Queste stelle furono chiamate giganti, rispetto a quelle tipo Sole. Poi vi erano quelle molto più piccole del Sole che divennero nane. Fu poi Russel, indipendentemente, a notare che le stelle rosse della classificazione spettrale K ed M possono essere di due tipi: quelle che hanno un grande volume ma una minima densità e quelle che hanno un piccolo volume ed una grande densità. Quest’ultimo approccio al problema, per altra via, portava allo stesso risultato precedente. E’ da qui che i due partirono per realizzare (1912) il loro diagramma. Altra considerazione di carattere molto più generale ed implicante una visione cosmologica molto più spinta, riguarda l’ordine in cui le stelle sono disposte nel diagramma. Si osserva facilmente che la maggioranza delle stelle sono organizzate nella sequenza principale e poche di esse sono più su o più giù di quella immaginaria linea obliqua rappresentata da tale sequenza. Le abbondanze relative delle stelle nelle diverse zone del diagramma sono eloquenti: circa l’85% delle stelle si trova nella sequenza principale, mentre il restante 15% è distribuito tra nane bianche e giganti rosse (con trascurabili percentuali per altre zone del diagramma. Non vi un andamento casuale con stelle sparpagliate senza alcun ordine e la figura seguente sottolinea meglio quanto detto.

L’EVOLUZIONE DELL’UNIVERSO:

UNA CONVERSAZIONE

Siamo praticamente alla fine della Prima Guerra Mondiale. Da questo momento entrano nell’astrofisica teorica varie scoperte fisiche accumulatesi negli anni dal 1900 al 1917: la quantizzazione, la relatività ristretta, la struttura degli atomi nel modello di Bohr-Sommerfeld, la prima formulazione della relatività generale. Ciò permette una comprensione molto più approfondita di tutti i fenomeni in gioco. Anni dopo, le conoscenze fisiche della fisica del nucleo atomico permetteranno di risolvere definitivamente il problema dell’energia delle stelle. Anche gli strumenti di indagine del cielo si affineranno con l’introduzione di nuove tecniche di ascolto dello spazio attraverso risposte ad onde elettromagnetiche inviate in esso con gigantesche antenne paraboliche sistemate addirittura dentro crateri di vulcani. Molti altri oggetti stellari verranno scoperti ed a volte senza nessuna visione ottica. Come al solito, ad un catalogo accurato e ad una classificazione con criteri qualunque, deve seguire un’organizzazione più generale che tenti in approcci successivi di cogliere una logica in quanto osservato. Al di là degli sporadici tentativi cui ho accennato, fino agli anni Venti del Novecento non vi era necessità di pensare a duna organizzazione del cosmo perché vi era quella di Newton che non era mai stata messa in discussione. Ed il cosmo newtoniano era costituito da masse ubbidienti alla gravitazione distribuite in uno spazio euclideo infinito in tutte le direzioni nel quale il tempo scorreva allo stesso modo in qualsiasi punto. In tale universo non vi erano limiti per le velocità degli oggetti che potevano essere pensate grandi a piacere con leggi di composizione galileiane senza limiti e restava un certo ruolo centrale per la Terra o, quantomeno, per il sistema solare. L’uomo immaginava una macchina indipendente dall’osservatore e credeva nell’esistenza di un riferimento assoluto a cui rapportare tutte le leggi. Le leggi di altrove non erano neppure prese in considerazione. Con il venir meno del ruolo centrale della Terra e del sistema solare si tentò l’ultima carta, quella dell’etere come riferimento assoluto. Ma Michelson e Morley, sul finire dell’Ottocento mostrarono che l’etere non esiste facendo crollare l’ultimo appiglio. Quell’universo era un universo statico che nasceva per mancanza di dati osservativi adeguati. Se esso era pensato finito la stessa teoria della gravitazione, portata fino in fondo, negava tale universo perché esso sarebbe dovuto collassare, in tempi più o meno lunghi verso un certo punto. E se fosse stato pensato infinito creava il paradosso di Olbers.

Nel 1905, con la relatività ristretta, Einstein introdusse nella fisica gli osservatori, si sbarazzò del riferimento assoluto, ammise la costanza della velocità della luce per qualsiasi osservatore e trovò l’identità tra materia ed energia. Se non c’era più un riferimento rispetto al quale le leggi fisiche avevano valore assoluto, occorreva ammettere che in tutto l’universo valgono le stesse leggi fisiche e questa posizione, opportunamente sviluppata portò a quello che è il principio cosmologico che, si badi bene, è una posizione filosofica, una ipotesi che è comunque accettata ancora oggi da tutti gli scienziati. Il principio cosmologico afferma che un osservatore che si trovasse su una galassia, in qualunque punto dell’universo, deve, in un dato momento, osservare essenzialmente ciò che osserva qualunque altro osservatore in qualunque altra galassia dell’universo(19). Il lavoro di Einstein andò avanti e tra il 1915 ed il 1917 estese le conclusioni della relatività ristretta, valide solo per sistemi di riferimento inerziali (sistemi in cui vale il principio d’inerzia che non vale ad esempio su una piattaforma ruotante ed in un campo gravitazionale), a sistemi di riferimento qualunque, in particolare a quelli accelerati. Einstein mostrò che l’equivalenza tra sistemi di osservatori non deve riguardare i soli inerziali. Almeno per un certo tipo di equivalenza deve essere possibile estendere tale proprietà ad osservatori accelerati. Questo programma di relatività generale(20) aveva intrinsecamente dentro la messa in discussione della gravitazione ed Einstein, per la prima volta dopo Newton, costruì una nuova teoria della gravitazione fornendo equazioni che descrivevano in modo più completo della stupenda teoria di Newton il campo gravitazionale, liberando tra l’altro l’universo dalla schiavitù di spazio e tempo assoluti (una vera incrinatura logica). Lo spazio einsteniano è il superamento dello spazio euclideo che era stato di Newton e l’introduzione di uno spazio curvo, uno spazio che non ha proprietà costanti ma subisce l’influenza, deformandosi, di masse presenti in esso.

Vediamo un poco meglio. Se ci muoviamo con una data accelerazione vediamo gli altri corpi che si muovono rispetto a noi con una accelerazione opposta. Poiché abbiamo familiarità con la meccanica di Newton, attribuiremo l’accelerazione di questi corpi a forze proporzionali alle loro masse(Seconda legge di Newton). Le accelerazioni però insorgono solo quando siamo su sistemi non inerziali. Esiste però una forza che ha lo stesso tipo di comportamento: quella gravitazionale. Essa ha una proprietà peculiare: imprime a tutti i corpi la stessa accelerazione. E questa forza risulta proporzionale alla massa del corpo. Se parliamo di altre forze ci accorgiamo che ognuna è diversa dall’altra e che ciascuna agisce in modo diverso.

Ma torniamo ad un sistema inerziale. Esso risulta tale quando abbiamo eliminato tutte le forze. Ma, disgraziatamente, non ci possiamo liberare della gravitazione. Einstein iniziò allora con il pensare che inerzia e gravitazione sono la stessa cosa: entrambe agiscono sui corpi allo stesso modo e le forze che ne risultano sono, per entrambe, proporzionali alle masse dei corpi stessi. Vi è allora qualcosa che non va nel principio d’inerzia che occorrerà riformulare. La versione fino ad allora accettata diceva: Esiste per i corpi uno stato di moto standard, tale che un corpo che si trovi in questo stato di moto non è sottoposto ad alcuna forza. Questo moto standard è il moto rettilineo uniforme. La nuova versione dovrà essere: Esiste per i corpi uno stato di moto standard, tale che un corpo che si trovi in questo stato di moto non è sottoposto ad alcuna forza. Questo stato di moto segue l’inerzia e la gravitazione. Solo se un corpo dovesse deviare da un tale stato di caduta libera diremo che su di esso agisce una forza.

Una forza è dunque qualcosa che tende ad allontanare i corpi dalle loro traiettorie standard, ciò che non vale per la gravitazione. Arriviamo così a questa nuovissima affermazione: la gravitazione non è da considerarsi come forza ma come inerzia. In termini più tecnici questa cosa la si può dire così: la gravitazione non è una forza ma una distorsione dello spazio-tempo. Se si è in uno stato di caduta libera, la gravitazione intorno a noi sparisce (ecco la ragione dell’assenza di peso nelle astronavi). Con ciò non si riesce però ad eliminare la non-uniformità della gravitazione (la gravitazione è uniforme in una stanza ma non lo è su grandi estensioni come l’Europa) e ciò vuol dire che vi sarà sempre una accelerazione relativa ai corpi vicini.

In definitiva, l’impossibilità di eliminare completamente il campo gravitazionale è causa permanente di un’accelerazione relativa tra corpi e per costruire una teoria della gravitazione, l’effetto intrinseco fondamentale che occorre descrivere è proprio l’accelerazione relativa tra corpi vicini. In questo nuovo modo di vedere le cose, occorre dire che la relatività ristretta continua a valere su piccola scala, quando le distanze tra osservatori sono piccole; la gravitazione universale continua a valere su grandi distanze e deboli campi gravitazionali.

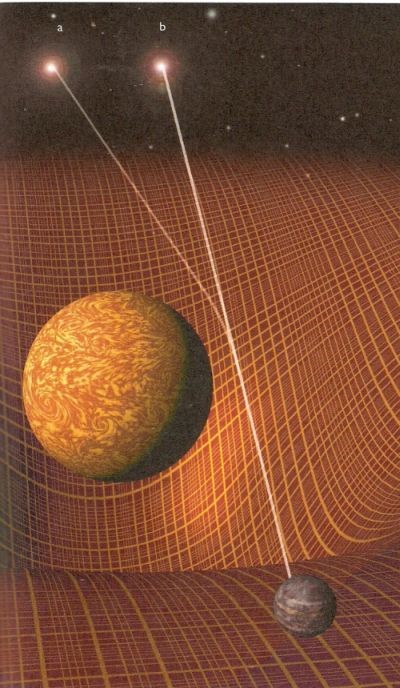

Ma ritorniamo alla gravitazione come distorsione dello spazio-tempo (sia dello spazio che del tempo) di cui parlavo poco fa. Questo è uno dei risultati che la complessa elaborazione matematica della relatività generale ci ha fornito. Naturalmente vi sono state ulteriori elaborazioni dopo quella di Einstein. Ma su questo punto specifico, tutte le teorie convergono: lo spazio è deformato dal campo gravitazionale ed il tempo scorre in modo differente a seconda dell’intensità del campo. Più forte è il campo gravitazionale, più il tempo trascorre piano. Vi sono delle stelle così grandi da avere una gravità che rallenta enormemente il tempo. In definitiva, una massa modifica la supposta omogeneità ed isotropia dello spazio-tempo e la prima verifica di ciò fu realizzata dal fisico britannico A. Eddington durante un’eclisse di Sole osservata nell’isola di Principe (Guinea) ed a Sobral (Brasile) nel 1919.

La luce di una stella che passa vicino al Sole è deflessa perché la massa del sole incurva lo spazio-tempo. Invece di vedere la stella nella sua posizione reale (quella che osserviamo in condizioni normali) la vediamo in altra posizione quando tra la stella e la Terra è interposta una massa come quella del Sole (il fenomeno è osservabile solo on eclissi. La seconda figura mostra il senso di curvatura dello spazio. Una massa corrisponde ad una deformazione di esso in figura rappresentata come una buca di potenziale.

La relatività generale, come accennato, è una teoria di campo, quello gravitazionale. Essa fornisce le equazioni del campo dalle cui soluzioni discendono varie possibili descrizioni dell’universo, un modello di universo(21). Fu proprio Einstein a descrivere un primo universo relativistico ma in un’epoca in cui ancora non si era scoperto il moto di allontanamento delle galassie (che, per il principio cosmologico, è visto allo stesso modo da qualunque punto dello spazio) e quindi quando ancora si riteneva che l’universo fosse statico (salvo moti locali minori). Costruì la sua teoria con questo presupposto e con l’ipotesi di spazio curvo con volume enorme ma finito senza osare di più e dovette fare un’operazione che egli stesso in seguito considerò grave errore di cui si pentì molto. Egli, dalle equazioni che aveva costruito, cercò soluzioni che rispondessero ad un universo statico e, …. non le trovò. Tutti i suoi universi matematici collassavano perché tutte le soluzioni portavano ad un universo dinamico. Non ebbe fiducia nei suoi calcoli che avrebbero dovuto convincerlo della necessità di universo dinamico. Questa circostanza lo mise fortemente in crisi ed egli iniziò a pensare che l’intero edificio della relatività generale fosse da ridiscutere. Alla fine trovò un rimedio, quello che lo fece poi pentire: modificò le sue stesse equazioni di campo introducendovi un termine, indicato con λ e chiamato costante cosmologica, che doveva rimettere a posto le cose, impedendo al suo universo statico di collassare. La costante cosmologica rappresenta una forza cosmica repulsiva a lungo raggio che mantiene in piedi l’universo contrastando la gravità. Essa ha la caratteristica di agire più intensamente quanto maggiore è la distanza tra galassie (rovesciamento di quanto ordinariamente si pensa): non risulta quindi rilevabile sulle brevi distanze di laboratorio e quindi è una invenzione che serve solo a giustificare un preconcetto (di questi esempi in fisica se ne hanno molti ma chi ci cade mostra la sua grandezza quando, come Einstein, riconosce la loro vacuità ed Einstein ebbe a dire più tardi che l’inclusione della costante cosmologica nelle equazioni di campo della relatività generale era stata il più grande errore della sua vita). In ogni caso una teoria che si basa su entità nascoste non è seria. Le equazioni del campo furono risolte nello stesso 1917 dall’astronomo e matematico olandese Willem de Sitter (1872-1934) nell’ipotesi di universo vuoto di materia e radiazione ma in una espansione costante guidata dalla costante cosmologica λ (se ci mettiamo dentro una particella essa si allontana da noi come fanno le galassie)(22). Non c’è altro in tale universo e nessun osservatore è in grado di dire se è statico o no e, di fatto, diversi osservatori non riuscirebbero a mettersi d’accordo su cosa osservano e quale fisica utilizzano. Altra proprietà di tale universo è che non cambia nel tempo, un’idea nota come principio cosmologico perfetto. Si tratta di una esposizione matematica, puramente teorica che descrive un universo impossibile (un universo senza materia con il moto è l’inverso di quello di Einstein che ha la materia ma non il moto), ma con il pregio di fornire il primo cenno all’espansione, precedente le successive scoperte. L’universo di De Sitter, comunque, non è così stravagante come sembra se solo si pensa che nello spazio la densità di materia è estremamente bassa ed eccetto che per l’ammissione di vuoto questo universo risulta il medesimo che sarà proposto nel 1948 da Bondi, Gold ed Hoyle (come vedremo).

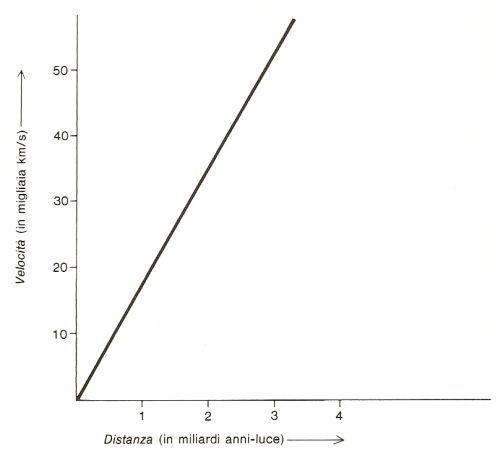

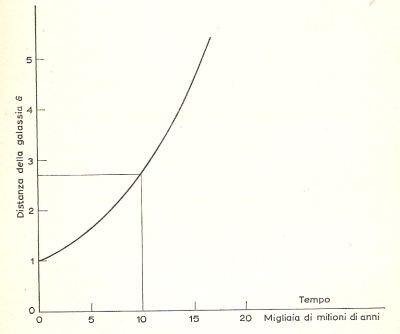

A partire dal 1929 si iniziò ad avere la certezza che l’universo si espandesse e, questi dati osservativi mostrarono naturalmente il perché non potevano funzionare le equazioni di campo forzate ad universi statici. L’osservazione metodica mostrava lo spostamento verso il rosso di circa il 90% degli spettri (redshift) provenienti da galassie e nebulose (in breve: spostamento verso il rosso della galassia), e se vale l’ipotesi che il fenomeno dello spostamento è dovuto all’effetto Doppler, vuol dire che le stelle si allontanano da qualunque punto le si osservi secondo il principio cosmologico. Fu in quest’anno che i due statunitensi Edwin Hubble (1889-1953), astrofisico, e Milton Humason (1891-1972)(23), astrronomo, scoprirono una legge che mette in relazione lo spostamento verso il rosso di una galassia con la sua distanza, tanto maggiore è la distanza della galassia e tanto maggiore sarà il suo redshift. In altre parole la legge empirica trovata dai due scienziati e chiamata solo Legge di Hubble (o legge H-H), afferma che più le galassie sono distanti, più si allontanano velocemente, come è illustrato nei due grafici seguenti.

La legge proveniva da dati osservativi ma occorre fare attenzione perché i dati osservativi possono essere interpretati nel contesto di un preconcetto, di un giudizio a priori, di una qualche legge non espressamente citata ma presente nel ragionamento. Nella legge in oggetto i dati osservativi dovrebbero essere lo spostamento verso il rosso e la distanza. Ma la distanza non è un dato osservativo perché si ottiene indirettamente tramite la relazione che lega luminosità apparente con luminosità intrinseca. Ciò vuol dire che i dati osservativi sono lo spostamento verso il rosso e la luminosità apparente. Anche lo spostamento verso il rosso può essere ritenuto come dovuto all’effetto Doppler, con la conseguenza di allontanamento delle galassie ad una data velocità. Ed ecco allora la legge di Hubble che è ricavata sotto tutte le condizioni dette, condizioni che sono all’interno di una teoria fisica, di un modo di leggere i dati che ha una sua logica e che può essere falsificato solo portando dati che neghino alcuna delle premesse. Einstein incontrò Hubble e da quelle conversazioni si convinse che l’universo si espandeva.

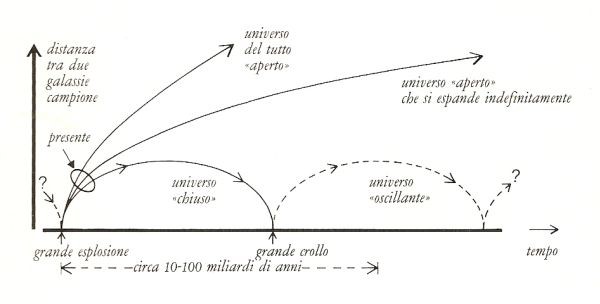

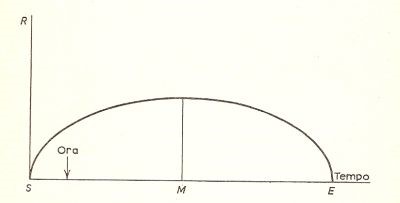

Modelli di grande interesse furono proposti dall’astronomo e prete belga George Lemaitre (1894-1966)(24) e dal cosmologo e matematico sovieticoAleksandr Aleksandrovič Fridman (1880-1925)(25) (successivamente sviluppati anche dall’astrofisico statunitense Howard Percy Robertson (1903-1961) e dall’astrofisico britannico Arthur Geoffrey Walker (1909-2001), di modo che questo modello di universo va sotto il nome di FRLW e nella moderna cosmologia assume il nome di modello standard). L’universo è inteso in evoluzione, un universo che cambia cioè con il passare del tempo. In particolare Fridman risolse le equazioni del campo prendendo in considerazione le tre possibili soluzioni matematicamente più accessibili che descrivevano un universo in espansione con differenti modalità (vedi figura).

Le tre soluzioni di Fridman alle equazioni del campo

Iniziamo dal punto interrogativo che compare nel disegno. E’ l’eventuale inizio dell’universo in un dato istante (quello noto come big bang da una espressione utilizzata da Hoyle in una trasmissione radio della BBC nel 1949). Da questo supposto istante (molto discusso), sarebbero passati intorno ai 10 o 15 miliardi di anni ed ora ci troveremmo là dove, nel disegno, è scritto presente. Da qui in poi si sviluppano le tre soluzioni di Fridman. Quella più in basso rappresenta l’universo sferico (chiuso e finito in un modello detto ellittico o cicloidale) che continuerebbe ad espandersi fino ad un suo massimo (effetti dell’esplosione iniziale che ancora scaglierebbe pezzi a distanza). Appena giunto a questo massimo, dato che le forze gravitazionali iniziano pian piano a prendere il sopravvento su quelle del moto inerziale dei pezzi iniziali, l’universo inizia una contrazione su se stesso fino a che il processo diventerà rapidamente implosivo, fino al punto in cui tutta la massa dell’universo la si ritroverà di nuovo in un “punto” in modo da originare un big crunch, un grande crollo. Di nuovo tutto finisce, ma di nuovo tutto riproduce l’esplosione di pezzi che sono implosi. Il processo, in linea teorica, è riproducibile fino a situazioni analoghe (non uguali!) a quelle che conosciamo. Il tutto proseguirebbe indefinitamente in un universo che chiameremo oscillante.

La curva intermedia rappresenta un universo che sarà sviluppato nel 1932 da Einstein e De Sitter (modello parabolico) congiuntamente e quella più in alto che presenta una curva più ripida (modello iperbolico) originata dall’ipotesi di velocità di espansione maggiore. Tali universi risulterebbero aperti, infiniti e con una distanza relativa tra galassie in continuo aumento.

Nel 1930 vi fu un intervento di Eddington che dimostrò l’instabilità del modello di Einstein. La perfetta funzione equilibratrice della gravitazione dovuta alla costante cosmologica poteva risultare modificata da una fluttuazione qualunque, sempre pensabile in un universo forse statico ma certamente con galassie in ebollizione. Sarebbe bastata quindi una piccola perturbazione per far collassare l’universo o per farlo espandere all’infinito. La sua proposta di universo ammetteva quella di Einstein e aggiungeva una perturbazione che avrebbe portato l’universo allo stato di espansione alla sua epoca noto. Fatto notevole è che in tale universo non vi sono punti singolari come quelli che prevedono una nascita ad un dato istante.

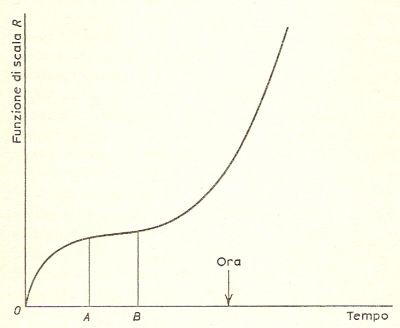

L’universo di Eddington che è quello di Einstein (linea tratteggiata) per un lunghissimo tempo poi, a seguito di una perturbazione, inizia ad espandersi (in ordinate vi è l’espansione).

Questo modello ha due difficoltà (superabili con ipotesi aggiuntive): da una parte non rende conto della formazione di elementi pesanti negli astri e non spiega come sia possibile la presenza di tanto idrogeno in un universo che proviene dall’infinito negativo (si sarebbe dovuto consumare tutto).

Eddington per questo suo lavoro si era ispirato al lavoro di Lemaitre ch per molti aspetti era simile al suo e per altri differente. Un aspetto che li legava era certamente la presenza di quel tormento che era la costante cosmologica. La figura seguente riporta le linee guida del modello di Lemaitre che prevede uno spazio curvo con un volume finito.

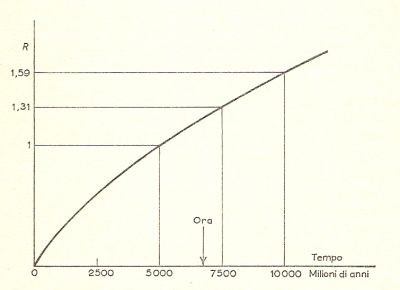

Si inizia con un big bang, il punto singolare, dal quale segue una primitiva rapida espansione senza l’intervento di λ. La rapida espansione, in questa fase, è rallentata dalla gravitazione. Nel tratto AB siamo in una situazione stazionaria analoga all’universo di Einstein in cui la costante cosmologica e la gravità si quasi uguagliano. Più oltre si ha la prevalenza della repulsione della costante cosmologica e l’universo inizia crescer sempre più rapidamente. Si può osservare che questo modello è analogo a quello cicloidale con la differenza che qui, tra A e B, ha prevalso la forza repulsiva su quella attrattiva. L’universo di Lemaitre è un’universo stranissimo almeno a partire da B. Una sua particolarità incredibile è la sua velocità espansiva che rende impossibile vedere una quantità incredibile di eventi dell’universo, tutti quelli avvenuti nel passato anche recente (non si potrebbero vedere ad esempio galassie lontane la cui luce non è ancora arrivata a noi essendo stata inviata vari anni fa), perché la luce non ce la fa a raggiungere il presente. La cosa è ancora più incredibile in un universo finito. Ma vi sono molte altre peculiarità di tale universo che lo rendono davvero fantastico ma che non meritano attenzione in questa sede.

Come annunciato, nel 1932, Einstein e de Sitter svilupparono un modello cosmologico che riscosse molto successo almeno fino al 1980. Si tratta dello sviluppo di uno dei tre modelli di Friedmann in cui la materia è situata in uno spazio di Minkowsky (lo spazio-tempo della relatività speciale in cui ogni punto dello spazio ha quattro coordinate, tre delle quali rappresentano un punto dello spazio, e la quarta un preciso momento temporale: intuitivamente, ciascun punto rappresenta quindi un evento), nel quale l’universo continuerà ad espandersi all’infinito.

Einstein e de Sitter a Pasadena (USA) nel 1932